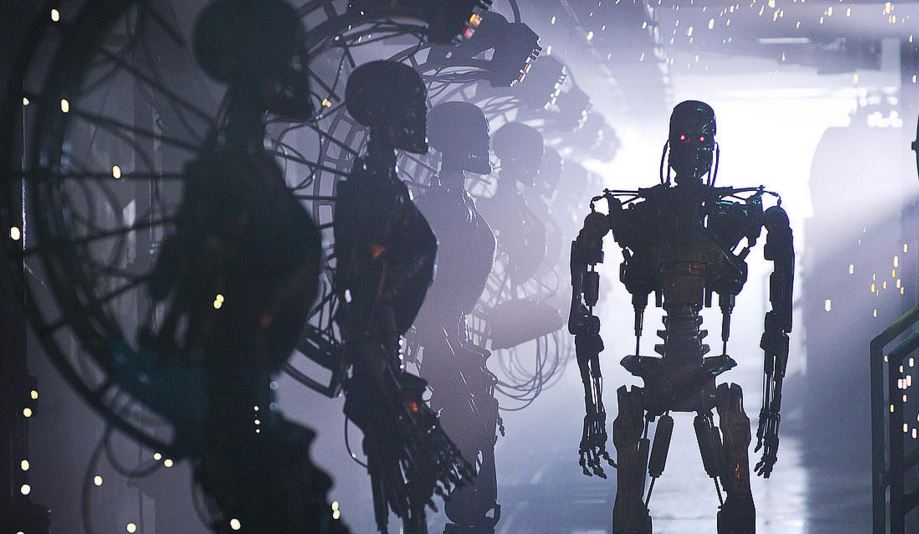

Хватит пророчеств. Апокалипсис ИИ уже начался

Люди слепо отдают власть искусственному интеллекту, но еще не поздно все изменить, уверен соавтор бестселлера ReWork и основатель Basecamp Дэвид Хенссон

Будущее Образ жизни

Ждать, когда искусственный интеллект превратит мир в апокалиптический кошмар, уже не нужно. Алгоритмы, основанные на ИИ, уже сегодня регулярно преподносят новые порции свежего ада. Но вместо того, чтобы переживать о выходящих из под контроля компьютерах, стоит побеспокоиться о предпринимателях, которые скармливают им алгоритмы, и потребителях, которые бездумно их используют.

Дело не в том, что Илон Маск, Стивен Хокинг и другие зря опасаются, что однажды Скайнет решит, будто человечество — это ошибка в коде Вселенной, которую нужно устранить. Так же, как протестанты не обязательно ошибаются, полагая, что вознесение однажды докажет конец истории. Вера в сверхъестественные рассказы о мстительных божествах, осуждающих нас всех на вечные страдания, – это краеугольный камень истории с момента когнитивной революции. Именно потому, что сегодня нет возможности опровергнуть такую историю.

Проблема в том, что такая озабоченность возможными бедствиями завтрашнего дня может отвлечь нас от борьбы с реальными бедствиями дня сегодняшнего. И проблемы с алгоритмами становятся все более масштабными, возникают все чаще и все сильнее влияют на нашу жизнь.

Растущий объем работы заставляет алгоритмы социальных сетей стимулировать зависимость и отчаяние. Доводить пользователей до максимально возможного состояния безумства, беспокойства и зависти. Потому что это самый глубокий колодец, где можно черпать активность пользователей.

Мы становимся все более несчастными, потому что империалисты всего мира строят машинное обучение на наших самых уязвимых и базовых импульсах. С помощью постоянных ухищрений они находят самые слабые места в нашей психике, а затем используют их с максимальной эффективностью. Все ради того, чтобы продавать рекламу автомобилей, шампуней или политических разногласий.

Такой эксплуататорский самооптимизирующийся ИИ вряд ли ограничивается социальными сетями. Но такие компании, как Facebook, с его помощью наносят огромный вред множеству людей.

Осознание того, что Facebook находит способы определить наше точное психическое состояние, а затем усилить его, удручает – хотя они и довольно правдоподобно это отрицают. Можно предположить, что Цукерберг и Сэндберг и правда верят, что на самом деле делают что-то хорошее для мира, даже если доказательства противоположного стремительно накапливаются.

Труднее придумать правдоподобное отрицание, когда авиакомпании используют алгоритмы на основе ИИ, чтобы рассаживать семьи по салону самолета, побуждая их заплатить сбор за выбор конкретного места.

Также трудно сказать, что ИИ, который управляет программами оплаты труда водителей в каршерингах, не ориентируется на распространенные когнитивные слабости.

Но, по крайней мере, эти алгоритмы действительно работают, какими бы дьявольскими они ни были. Это зло, но это то зло, о котором мы знаем. То, о котором можно порассуждать.

Апокалипсис ИИ, который меня на самом деле пугает на данный момент, – это дерьмовое шоу Predictim. Это компания, которая играет на природных страхах родителей во всем мире, опасающихся, что няня будет обходиться грубо с их ребенком, и продает этим родителям услуги по тестированию на склонность к насилию. Вот что они заявляют:

Predictim — инструмент, нужный всем родителям.

221. Это просто число, которое может означать все, что угодно, не так ли?

Но в конкретном случае оно означает, сколько обвинений предъявлено кошмарной няне из сельской Пенсильвании за жестокость и издевательства над детьми, за которыми она присматривала вместе с подругой.

Матери нужно было уехать из города, поэтому она просто доверилась человеку, с которым уже оставляла детей раньше.

Однако на этот раз няня оказалась безжалостной.

Думаю, вы уже в ужасе. Если у вас есть дети, конечно, да. Так что теперь вы находитесь в идеальном состоянии, чтобы купить их поистине апокалиптическое решение: Predictim намерен получить доступ ко всем социальным сетям потенциальных бэбиситтеров, чтобы алгоритм ИИ смог проанализировать их на употребление наркотиков, непристойное содержание, издевательства или неуважительное поведение. В результате получается показатель от одного до пяти, говорящий, насколько няня «внушает доверие» (кандидат не узнает результатов).

Трудно понять, с чего начать в этой чертовщине. Но давайте начнем с идеи о том, что ИИ может определить, проявляет ли кто-то «неуважительное отношение», основываясь на 22 постах Twitter. Отбросив смехотворную нехватку статистически значимых примеров, просто попробуйте представить, что за диагноз поставит ИИ на основе сарказма, возмущения, шуток, цитат или любой из миллионов форм высказываний в твитах. Черт, у меня есть твиты, которые люди с высшим образованием неправильно поняли в половине случаев!

Итак, это первый вывод: невозможно, чтобы это хоть как-то работало! Просто невозможно. Как же тогда компания вроде Predictim может продавать свое решение и утверждать, что якобы оно работает? Точно так же, как гороскопы в газете. По существу они заявляют, что это не настоящие советы, и их следует рассматривать только в развлекательных целях. Вот что говорят в Predictim:

Отказ от ответственности: этот результат основан исключительно на анализе учетных записей социальных сетей потенциального ситтера, к которым они предоставили нам доступ и которые могут не отображать фактические качества няни. Поэтому мы не можем предоставить какие-либо гарантии относительно точности результата или дать ответ на вопрос, подходит ли данный субъект для ваших нужд… Мы не несем никакой ответственности или обязательств за поведение любых лиц, осуществляющих уход, или за ваши взаимодействия или отношения с ними. ИСПОЛЬЗОВАНИЕ ЭТОГО ОТЧЕТА ИЛИ СЕРВИСА ОСТАЕТСЯ НА ВАШЕ УСМОТРЕНИЕ И ВАШ СОБСТВЕННЫЙ РИСК.

Это, конечно, полностью противоречит маркетинговым материалам:

Есть много способов найти кого-то, кто будет заботиться о ваших детях – агентства, онлайн-сервисы и рекомендации друзей и семьи. Тем не менее, многие интернет-службы не проводят всестороннюю проверку и не берут на себя ответственность за действия своих бэбиситтеров.

Predictim сохранит вашу семью в безопасности — или нет, никому не известно. Он, может быть, гарантирует, что вы не наймете Ребекку, у которой высокая степень риска, а может, и нет — мы не знаем! Печально известный стиль Кремниевой долины: они обещают все-все, но не несут никакой ответственности за последствия своих действий.

Давайте поговорим об этих последствиях. Просить нянь, которые могут быть несовершеннолетними, передать ключи к их частным аккаунтам в соцсетях — это не только мерзкое вторжение в их личное пространство, это уже на грани насилия и жестокости.

Учитывая такой высокий уровень ответственности – частные и, возможно, даже интимные данные бэбиситтеров, – хотелось бы получить железные гарантии в отношении того, как эти данные хранятся и используются. Это, конечно, не сделало бы сервис приемлемым, но все-таки, какие гарантии защиты данных предлагает Predictim?

«Если от нас утечет информация о ситтерах, это будет неприятно», — говорит Симонов.

Да, это действительно неприятно, Джоэл. Но простите меня за то, что я не могу быть уверен в нравственных принципах выпускника университета, который сейчас примерно в том же возрасте, в котором был Цукерберг, когда он задумался, почему «идиоты» доверяют ему свою информацию.

Цукерберг: да, если тебе когда-нибудь понадобится информация о ком-нибудь в Гарварде

Цукерберг: просто спроси

Цукерберг: у меня есть больше 4000 имейлов, картинок, адресов и т.д.

Друг: Что?! Как ты их раздобыл?

Цукерберг: Люди просто отправили это мне

Цукерберг: не знаю, почему

Цукерберг: они «доверяют мне»

Цукерберг: идиоты

Но это еще хуже. Намного хуже. Бэбиситтеры могут быть даже еще не студентами. И давайте посмотрим, что же имеют в виду технические директора, когда говорят о «вызывающем контенте», на основании которого Predictim выставляет оценки:

Фотография девушки в бикини.

И вот самое ужасное. По данным Washington Post, уже существует определенная масса родителей, которые хотят, чтобы «продвинутый искусственный интеллект» нарушал неприкосновенность частной жизни нянь, лишь бы они могли выбирать кандидатов, исходя из какой-то базовой оценки.

Диана Вернер, мать двоих детей, живущая к северу от Сан-Франциско, считает, что няни должны быть готовы поделиться своей личной информацией, чтобы успокоить родителей. «Проверка бэкграунда – это хорошо, но Predictim идет вглубь, действительно анализируя человека – его социальный и психический статус», — говорит она. По ее мнению, там, где она живет, «100% родителей захотят использовать это». «Мы все хотим идеальную няню», — добавляет она.

«Идеальная няня» звучит как название фильма ужасов. Впрочем, я не виню Вернер. Может быть, она не очень разбирается в технологиях. Когда Маск и Хокинг, воздевая руки к небу, твердят, что Великий ИИ скоро превратит нас в рабов, и нам нужно как можно скорее принять соответствующие законы, трудно винить людей за то, что они хотят получить доступ к личным данным бэбиситтера.

Гораздо труднее оправдать специалистов, которые действительно должны понимать, что к чему. Вот Крис Мессина (бывший дизайнер Google и изобретатель хэштега) считает, что каждый родитель должен использовать Predictim или что-то подобное, ДАЖЕ ЕСЛИ ЭТО НЕ РАБОТАЕТ:

https://twitter.com/chrismessina/status/1066423864371150849

Как я уже сказал, апокалипсис ИИ уже начался. Горн протрубил, и родители, такие как Вернер и Мессина, готовы потворствовать любым чудовищным вторжениям в личную жизнь и достоинство, которых требует Великий ИИ в Облаке.

Но еще не поздно дать отпор. Преимущество — на нашей стороне. Мы можем отвергнуть, отрегулировать и высмеять алгоритмы, основанные на ИИ, если они посягнут на то, что важно для нас. И прогресс не всегда линеен, периодически он попадает в тупик.

Великий ИИ в Облаке еще не стал всеведающим, и мы должны подвергать сомнению логику его работы. Очень вероятно, что если мы это сделаем, то увидим, что в основе ее лежит полная чушь.

Vanity Fair

Vanity Fair Quartz

Quartz MIT Technology Review

MIT Technology Review Backchannel

Backchannel

Aeon

Aeon

Альпина Паблишер

Альпина Паблишер

Psychology Today

Psychology Today